DeepMind запускает новую исследовательскую группу для изучения этики искусственного интеллекта

DeepMind запускает новую исследовательскую группу для изучения этики искусственного интеллекта

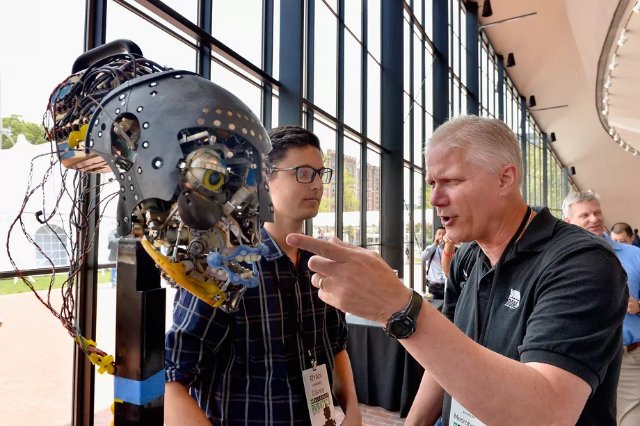

Подразделение компании DeepMind, что занимается искусственным интеллектом, решила основательно заняться вопросами этики. Google купила данную компания в 2014 году и уже сегодня она представила исследовательскую группу, которая будет заниматься всеми важными проблемами, что возникают вокруг искусственного интеллекта. К ним относятся проблемы предвзятости к ИИ; предстоящее экономическое влияние автоматизации; и необходимость обеспечения того, чтобы любые интеллектуальные системы, которые мы развиваем, разделяют наши этические и моральные ценности.

DeepMind Ethics & Society (или DMES, так как новая команда была названа) выпустит исследования по этим темам и другим, начиная с начала следующего года. На данный момент команда насчитывает восемь исследователей, но DeepMind хочет увеличить их примерно до 26 в течение года. В команде шесть неоплачиваемых внешних «стипендиатов» (включая философа Оксфорда Ника Бострома, который буквально написал книгу об экзистенциальном риске ИИ), которые будут сотрудничать с академическими группами, проводящими аналогичные исследования.

В сообщении в блоге, объявляющем о своей команде, соучредители Верити Хардинг и Шон Легассик пишут, что DMES поможет DeepMind «изучить и понять реальное воздействие ИИ». На примерах того, как выглядит эта работа, они упоминают расследования расизма в алгоритмы уголовного правосудия и обсуждение таких тем, как этика аварий в машинах без водителя. «Если технологии ИИ должны служить обществу, они должны определяться приоритетами и проблемами общества», - пишет Хардинг и Легассик.

DeepMind сама по себе слишком осведомлена об этих проблемах, после того, как в прошлом году ее критиковали за ее работу с Национальной службой здравоохранения Великобритании (NHS). Сделка DeepMind с тремя лондонскими больницами в 2015 году, в которой она обрабатывала медицинские данные, принадлежащие 1,6 миллионам пациентов, в этом году была признана незаконной и компания не сообщила людям, что их данные использовались. Позже DeepMind заявила, что «недооценила сложность NHS и правил вокруг данных пациентов» и наняла новых независимых этических экспертов для изучения любых будущих сделок.

Хотя создание DMES является доказательством того, что DeepMind активно и открыто рассматривает проблемы того, как ИИ повлияет на общество, компания будет по-прежнему сталкиваться с вопросами об этических последствиях своей собственной работы. Сообщается, что исследователи DMES будут работать параллельно с персоналом, создающим собственные продукты DeepMind; и внутренняя комиссия по обзору этики компании остается скрытой в тайне. Естественно, существуют ограничения на то, насколько прозрачной может быть частная компания, работающая над передовыми технологиями, но, по-видимому, DMES также может решить эту тему.